Το μεγάλο κακό ξεκίνησε με ένα από τα πιο viral βίντεο του Ιανουαρίου. Ο Logan Paul, μια διασημότητα του YouTube, σκοντάφτει σε έναν νεκρό που κρέμεται από ένα δέντρο. Ο 22χρονος, βρίσκεται στο ιαπωνικό δάσος των αυτοχείρων, μοιάζει στην αρχή σοκαρισμένος, αλλά στη συνέχεια φαίνεται να το διασκεδάζει. «Τα χέρια του είναι μελανιασμένα», λέει, πριν γυρίσει στους φίλους του χαζογελώντας. «Έχετε σταθεί ποτέ δίπλα σε έναν νεκρό;», τους ρωτάει.

Ο Paul, ο οποίος έχει 16 εκατομμύρια πιτσιρικάδες συνδρομητές στο κανάλι του YouTube, αφαίρεσε το βίντεο 24 ώρες αργότερα, εν μέσω μιας οργισμένης αντίδρασης. 24 ώρες, όμως, ήταν αρκετές για να κερδίσει το βίντεο 6 εκατομμύρια προβολές. Και μια θέση στην πολυπόθητη λίστα των δημοφιλών βίντεο του YouTube.

Οι μεγάλες τεχνολογικές εταιρείες ξεκίνησαν την μεγαλύτερη διάδοση της πληροφορίας στην ιστορία της ανθρωπότητας κάτω από το έμβλημα του ελεύθερου και του ανοικτού λόγου. Τώρα, αυτοί οι ίδιοι οι φύλακες του ελεύθερου και ανοικτού λόγου, μεταμορφώνονται στην μεγαλύτερη απειλή του.

Εάν μέσα σε αυτές τις 24 ώρες που το διαβόητο βίντεο έτρεξε ζωντανά στο YouTube, κάποιος έριχνε μια ματιά στα γειτονικά βίντεο ή σε εκείνα που θα ακολουθούσαν μέσα από την «Up Next» λειτουργία της πλατφόρμας, θα μπορούσε να δει πόσο γρήγορα και πόσο μαζικά εξαπλώθηκε η είδηση. Δίπλα σε ένα σωρό βίντεο που χλεύαζαν τους έφηβους οπαδούς του Logan Paul, ήταν στοιβαγμένη όλη η εφηβική τρέλα και χαζομάρα, τεκμηριωμένη είτε από CCTV κάμερες είτε από κινητά τηλέφωνα.

Όλο αυτό το βίντεο υλικό, δεν είναι τίποτα παραπάνω από μια συνηθισμένη διεργασία του αλγόριθμου της πλατφόρμας, ο οποίος σχεδιάζει ένα ταξίδι με δική του βούληση. Συγκεκριμένα στη δική μου περίπτωση, εκείνες τις γιορτινές μέρες, το ταξίδι αυτό κορυφώθηκε με ένα βίντεο δύο αγοριών στη Ρωσία, ηλικίας περίπου πέντε ή έξι, που ο ένας έσπασε το δόντι του άλλου με μια μπουνιά, ενώ ο σκηνοθέτης αντί να τους χωρίσει συνέχισε να τους καταγράφει να τσακώνονται.

Αυτή τη στιγμή υπάρχουν περισσότερα από 1,5 δισεκατομμύρια εγγεγραμμένοι χρήστες στο YouTube. Το νούμερο υπερβαίνει τον αριθμό των νοικοκυριών που διαθέτουν τηλεοράσεις. Αυτό που παρακολουθούν όλοι αυτοί μέσα στο YouTube, διαμορφώνεται από τον αλγόριθμο, ο οποίος απομακρύνει και ταξινομεί δισεκατομμύρια βίντεο για να εντοπίσει τα 20 «επόμενα» κλιπ, τα οποία πρέπει να είναι σχετικά με το προηγούμενο και πιθανότατα, στατιστικά μιλώντας, να μπορούν να κρατήσουν το θεατή γαντζωμένο στην οθόνη του.

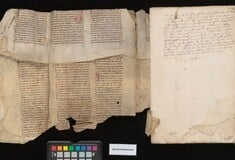

Αυτός ο αλγόριθμος είναι η μοναδική, πιο σημαντική κινητήρια δύναμη της ανάπτυξης του YouTube. Σε μία από τις λίγες δημόσιες εξηγήσεις για το πώς λειτουργεί αυτός ο τύπος αλγορίθμου - ένα ακαδημαϊκό έγγραφο που σκιαγραφεί πώς τα βαθιά νευρωνικά δίκτυα του αλγορίθμου επεξεργάζονται μια τεράστια συλλογή δεδομένων για τα βίντεο και τους ανθρώπους που τα παρακολουθούν - οι ίδιοι οι μηχανικοί του YouTube, Paul Covington, Jay Adams και Emre Sargin, το χαρακτηρίζουν ως ένα από τα «μεγαλύτερης κλίμακας εξελιγμένα συστήματα βιομηχανικών συστάσεων που υπάρχουν».

Αυτούς τους τελευταίους μήνες, έχει επίσης γίνει και ένα από τα πιο αμφιλεγόμενα. Ο αλγόριθμος έχει βρεθεί ότι προωθεί θεωρίες συνωμοσίας σχετικά με πρόσφατο μακελειό στο Λας Βέγκας ή ότι δημιουργεί, μέσω συστάσεων, μια ακμάζουσα υποκουλτούρα που στοχεύει τα παιδιά. Τι τους δίνει; Φαινομενικά αθώο, αλλά ενοχλητικό περιεχόμενο, ανάμεσα στα κινούμενα σχέδια που βλέπουν, στα οποία ένας καρτούν χαρακτήρας μπορεί να τρώει τον πατέρα του ή να πίνει χλωρίνη.

Φυσικά, όλο αυτό οδήγησε στην επανεξέταση και την αναδιαμόρφωση των αλγοριθμικών παραμέτρων του YouTube Kids. Κάθε είδους ανάρμοστου υλικού αφαιρέθηκε, ακόμα και από «αφελείς» γονείς δημιουργούς που έδειχναν τα σημάδια ασθενειών στα σώματα των παιδιών τους ή που τα τραβούσαν βίντεο να κλαίνε πάνω από τα νεκρά κατοικίδια ζωάκια τους.

Η Google απάντησε σε κάθε είδους διαμάχη λαμβάνοντας «σκληρά» μέτρα. Κατέβασε κάθε είδους προσβλητικό βίντεο, αφαίρεσε την άδεια νομισματοποίησης από μικρούς λογαριασμούς, τόνισε ότι θα υπάρχει πιο λεπτομερής έλεγχος του υλικού που ανεβαίνει, επέκτεινε τη στρατιωτική δύναμη των ανθρώπινων συντονιστών του. Ωστόσο, καμία από αυτές τις κινήσεις δεν μείωσε την αυξανόμενη ανησυχία ότι κάτι δεν πάει καθόλου καλά με την τεχνητή νοημοσύνη του τροφοδοτεί το YouTube.

Πολλά έχουν γραφτεί για τον αντίκτυπο του Facebook και του Twitter στην πολιτική, αλλά τους τελευταίους μήνες δεν είναι λίγοι εκείνοι οι ακαδημαϊκοί που συμφωνούν πως και οι αλγόριθμοι του YouTube μπορεί να έχουν συμβάλει στην παραπληροφόρηση κατά τις προεδρικές εκλογές του 2016 στις ΗΠΑ. «Το YouTube είναι η πιο παραβλεπόμενη ιστορία του 2016», έγραψε η τουρκάλα Zeynep Tufekci, μια ευρέως σεβαστή κοινωνιολόγος και κριτής τεχνολογίας, στο λογαριασμό της στο Twitter. «Οι αλγόριθμοι αναζήτησης και συνιστώσας είναι μεγάλες μηχανές παραπληροφόρησης».

Εάν ο αλγόριθμος των συστάσεων του YouTube έχει πραγματικά εξελιχθεί τόσο ώστε να προωθήσει περισσότερο ενοχλητικό περιεχόμενο, πώς συνέβη αυτό; Και τι αντίκτυπο μπορεί να έχει αυτό, όχι μόνο για την τοπική, αλλά για την παγκόσμια πολιτική σκηνή;

Φυσικά, δεν είναι εύκολο να απαντηθούν τέτοιου είδους ερωτήσεις. Όπως όλες οι μεγάλες εταιρείες τεχνολογίας, το YouTube δεν επιτρέπει σε κανέναν κοινό θνητό να δει ή να μελετήσει τους αλγόριθμους που διαμορφώνουν τη ζωή του. Είναι μυστικές φόρμουλες, ιδιόκτητο λογισμικό και μόνο επιλεγμένοι μηχανικοί έχουν το δικαίωμα (και την πρόσβαση) να εργαστούν για τον αλγόριθμο. Ο Γάλλος Guillaume Chaslot, ένας 36χρονος προγραμματιστής ηλεκτρονικών υπολογιστών με διδακτορικό στην τεχνητή νοημοσύνη, ήταν ένας από αυτούς τους μηχανικούς.

Κατά τη διάρκεια των τριών ετών που εργάστηκε στο Google, τοποθετήθηκε για αρκετούς μήνες με μια ομάδα μηχανικών του YouTube που εργάζονταν στο σύστημα συστάσεων. Η εμπειρία τον οδήγησε στο συμπέρασμα ότι οι προτεραιότητες που δίνει το YouTube στους αλγόριθμους του είναι πραγματικά επικίνδυνες.

«Το YouTube είναι κάτι που μοιάζει με την αληθινή ζωή, με την πραγματικότητα γύρω μας, αλλά μέχρι να έρθει στην οθόνη, έχει παραμορφωθεί τόσο πολύ, απλά για να σας κάνει να περάσετε περισσότερο χρόνο online μαζί του. Ο αλγόριθμος δεν αξιοποιεί το τι είναι ειλικρινές, ισορροπημένο ή υγιές για τη δημοκρατία», θα πει ο Chaslot σε συνέντευξή του στον Guardian.

Λίγο πολύ η εξήγηση που δίνει ο Chaslot είναι γνωστή σε όλους: ο αλγόριθμός δεν μένει ποτέ ο ίδιος. Μεταβάλλει συνεχώς το βάρος που δίνει σε όλα τα διαφορετικά σήματα που δέχεται: για παράδειγμα, τo μοτίβο της παρακολούθησης ενός χρήστη ή το χρονικό διάστημα ενός βίντεο που θα δει κάποιος πριν κλικάρει σε κάτι άλλο. Ο χρόνος αυτός, ήταν και είναι η πιο σημαντική προτεραιότητα του YouTube.

Ο Guillaume Chaslot απολύθηκε από την Google το 2013, λόγω υπέρμετρης επίδοσης. Ο ίδιος επιμένει ότι τον έδιωξαν μετά από μια ταραγμένη ακολουθία αποτυχημένων του προτάσεων για αλλαγές. Χρησιμοποιούσε τον προσωπικό του χρόνο για να συνεργαστεί με ομοϊδεάτες μηχανικούς ώστε να προτείνει αλλαγές που θα μπορούσαν να διαφοροποιήσουν το περιεχόμενο που βλέπει ο κόσμος.

«Υπάρχουν πολλοί τρόποι με τους οποίους το YouTube μπορεί να αλλάξει τους αλγόριθμους ώστε να καταστείλει τις ψεύτικες ειδήσεις και να βελτιώσει την ποιότητα και την ποικιλία των βίντεο που βλέπουν οι άνθρωποι. Προσπάθησα να αλλάξω το YouTube από μέσα αλλά δεν λειτούργησε», τονίζει.

Για να καταλάβει κανείς γιατί κανένας δεν τον άκουσε μέσα στην Google και γιατί κατέληξε να απολυθεί, θα πρέπει να ανατρέξει λίγο στο παρελθόν. Το σύστημα συστάσεων του YouTube έχει ως γνωστόν εξελιχθεί από τότε που ο Chaslot απολύθηκε. Η εταιρεία έχει δηλώσει ότι από το 2016 άρχισε να λαμβάνει υπόψη την ικανοποίηση των χρηστών, χρησιμοποιώντας ως παραδείγματα έρευνες ή εξετάζοντας το πόσο «αρέσει» ένα βίντεο, για να «εξασφαλίσει ότι το κοινό θα μείνει ικανοποιημένο από αυτό που είδε». Επίσης, μετά από κάθε είδους ρατσιστικό επεισόδιο, μετά από τα αλλεπάλληλα μακελειά στις ΗΠΑ, μετά από την έξαρση της ασθένειας των ψεύτικων ειδήσεων και μετά το βίντεο του Logan Paul ανακοίνωσε ότι λαμβάνει σκληρά μέτρα, σφραγίζει λογαριασμούς, δεν πληρώνει κανέναν που ανεβάζει χαζομάρες και ηλίθιο περιεχόμενο και αφαιρεί, αυτόματα, κάθε είδους βίντεο που περιέχει «προκλητικό θρησκευτικό ή ρατσιστικό περιεχόμενο».

Αυτό που δεν έχει πει, όμως, ακόμη η Google, η οποία εξαγόρασε το YouTube το 2006, είναι γιατί περίμενε δέκα χρόνια για να κάνει αυτές τις αλλαγές. Και ίσως γι' αυτό ο Chaslot έχασε τη θέση του, επειδή κατάλαβε ότι κάθε είδους αλλαγή είναι κοσμητική, και δυστυχώς τίποτα (παρά μόνο η ριζική αλλαγή της διαφημιστικής πολιτικής της εταιρείας), δεν μπορεί να αλλάξει τις ενοχλητικές προκαταλήψεις που έχουν εξελιχθεί στο νευρωνικό δίκτυο του αλγόριθμου.

Για να καταλάβουμε τι σημαίνει «προκατάληψη» στο σύστημα του YouTube θα πρέπει να σκεφτούμε ότι η πολιτική του (και της μητρικής εταιρείας, Google) τονίζει ότι δεν συμμετέχει στην λογοκρισία περιεχομένου, αλλά διατηρεί κάθε δικαίωμα να εξετάζει την «πρόθεση» και το «στόχο» όλων των βίντεο. Επίσης, τονίζει ότι η λειτουργία του «περιορισμού» και του γονικού ελέγχου προορίζεται να χρησιμοποιείται από τους γονείς για να φιλτράρει ανεπιθύμητο βίαιο και σεξουαλικό περιεχόμενο από τα παιδιά τους.

Αυτή τη στιγμή υπάρχουν χιλιάδες λογαριασμοί που δεν έχουν τέτοιο χαρακτήρα, ούτε διαθέτουν ενοχλητικό ή προκλητικό περιεχόμενο, και παραμένουν σφραγισμένοι. Τόσο ο Chaslot, όσο και άλλοι πανεπιστημιακοί ερευνητές ισχυρίζονται ότι υπάρχει ένας είδος παρανοϊκής λογοκρισίας, όχι μόνο στο YouTube και στην Google, αλλά σχεδόν σε όλους τους τεχνολογικούς γίγαντες του κόσμου.

Νωρίς το 2016, ξεκίνησε αρχικά το βασανιστήριο του Facebook, όταν αναφέρθηκε πρώτη φορά ότι οι υπάλληλοι του καταπίεσαν ή «φρέναραν» τις απόψεις των συντηρητικών. Μετά από αυτό άνοιξαν οι πύλες της κόλασης και για τον Zuckerberg. Την ίδια χρονιά το Twitter διαγράφει τον Milo Yannopoulos. Παρά το γεγονός ότι ο συντάκτης αυτού του άρθρου δεν συμφωνεί με τις θέσεις ή τα επιχειρήματα του κυρίου Yannopoulos, παραμένει σημαντικό να θυμόμαστε ότι αυτή τη στιγμή το Twitter μαστίζεται από εξτρεμιστές του ΙSIS και επικίνδυνα φανατικούς χρήστες του tag #BlackLivesMatter.

Ένα χαζό, ένα ηλίθιο, ένα κακόγουστο βίντεο, παραμονή πρωτοχρονιάς του 2018 ήταν η αφορμή για να καταλάβει όλος ο πλανήτης ότι και το YouTube αποτελεί έναν σημαντικό εκτελεστή αυτής της ανησυχητικής τάσης. Όπως οι ροές των ειδήσεων, έτσι και τα συνιστώμενα βίντεο διαμορφώνουν μια παγκόσμια κοινή γνώμη, ενώ οι αλγόριθμοι πίσω από όλες τις ηλεκτρονικές τοποθεσίες καθορίζουν τι είναι σημαντικό να δούμε ή να διαβάσουμε. Ακόμη και εάν ο στόχος μας είναι ένα αξιοθαύμαστο απόσπασμα πληροφορίας, ο αλγόριθμος θα βρει την ευκαιρία να φιλτράρει τα υπόλοιπα νέα που βλέπουμε σύμφωνα με τη σημασία αυτού που διαβάζουμε. Ελέγχει τη ροή της πληροφορίας, μας κατευθύνει σε ένα μονόδρομο, και τελικά σε ένα θάλαμο όπου ακούμε και βλέπουμε "μόνο" πράγματα με οποία συμφωνούμε.

Ο Chaslot έχει σχεδιάσει ένα λογισμικό που μπορεί να λειτουργήσει ως ένα πρώτο παράθυρο στον κόσμο της μηχανής των αδιάφανων συστάσεων του YouTube. Το πρόγραμμα προσομοιώνει τη συμπεριφορά ενός χρήστη που ξεκινά από ένα βίντεο και στη συνέχεια ακολουθεί την αλυσίδα των συνιστώμενων βίντεο – όπως θα μπορούσε να έκανε ο οποιοσδήποτε έφηβος μετά την παρακολούθηση του βίντεο του Logan Paul.

Κατά τη διάρκεια των τελευταίων 18 μηνών, ο Chaslot χρησιμοποίησε το πρόγραμμα για να διερευνήσει την προκατάληψη στο περιεχόμενο του YouTube που προωθήθηκε κατά τη διάρκεια των γαλλικών, βρετανικών και γερμανικών εκλογών και των μαζικών πυροβολισμών και δημοσίευσε τα ευρήματά του στην ιστοσελίδα του Algotransparency.org. Κάθε μελέτη του βρίσκει κάτι διαφορετικό, αλλά η έρευνα του υποδηλώνει ότι το YouTube συστηματικά ενισχύει βίντεο που είναι διχαστικά, συγκλονιστικά και συνωμοτικά.

Σύμφωνα με την έρευνα, περισσότερο από το 80% των βίντεο που συνέστησε το YouTube για τον παπά, ανιχνεύτηκε από το πρόγραμμά του ότι περιγράφει τον Καθολικό ηγέτη ως «κακό», «σατανικό» ή και ως τον ίδιο τον «Αντίχριστο». Ένα ακόμη συγκλονιστικό παράδειγμα εντοπίστηκε από το πρόγραμμά του Chaslot κατά την προετοιμασία των προεδρικών εκλογών του 2016: o αντίκτυπος του αλγορίθμου συστάσεων του YouTube δεν ήταν ουδέτερος κατά τη διάρκεια του προεδρικού αγώνα και προωθούσε βίντεο τα οποία ήταν κατά κύριο λόγο χρήσιμα μόνο για τον Τραμπ.

Ο Τραμπ κέρδισε το εκλογικό σώμα με το σωτήριο αποτέλεσμα 80.000 ψήφων από τρεις αμφιταλαντευόμενες πολιτείες των ΗΠΑ. Υπάρχουν περισσότεροι από 150 εκατομμύρια χρήστες του YouTube στις ΗΠΑ. Ακόμη και μια μικρή προκατάληψη στα συνιστώμενα βίντεο θα μπορούσε να είναι σημαντική, και εκεί οι αλγόριθμοι, οι οποίοι διαμορφώνουν το περιεχόμενο που βλέπουμε θα μπορούσαν να έχουν πολύ μεγάλη επίδραση, ιδιαίτερα στους αναποφάσιστους.

Η θεωρία που λέει ότι το YouTube προωθεί θεωρίες συνομωσίας θα μπορούσε να είναι μια θεωρία συνομωσίας από μόνη της. Αλλά, δυστυχώς, δεν είναι. Ο ανοιχτός κώδικας του Guillaume Chaslot αυτό αποδεικνύει. Σε όλη την περίοδο της προεκλογικής εκστρατείας τους, το YouTube ήταν έξι φορές πιο πιθανο να συστήσει βίντεο που βοηθούσαν τον Τραμπ και όχι την Κλίντον. Το YouTube πιθανότατα δεν προγραμμάτισε ποτέ τον αλγόριθμό του για να ωφελήσει έναν υποψήφιο έναντι του άλλου. Αλλά με βάση τα στοιχεία της έρευνας του Chaslot, αυτό ακριβώς συνέβη.

Πριν μερικές ημέρες, η Susan Wojcicki, CEO του YouTube, ανακοίνωσε ότι η πλατφόρμα θα προσθέσει πληροφορίες από τη Wikipedia σε βίντεο σχετικά με δημοφιλείς θεωρίες συνωμοσίας για την παροχή εναλλακτικών απόψεων σε αμφιλεγόμενα θέματα – χωρίς καν να το συζητήσει πρώτα με την online εγκυκλοπαίδεια. Ίσως, γιατί ο κλοιός σφίγγει και τα νέα στοιχεία δείχνουν ότι το Facebook και το Twitter δεν τελικά οι μοναδικοί ένοχοι στο πολιτικό έγκλημα που διαπράχθηκε στις εκλογές του 2016.

Εταιρείες όπως το Facebook, το Twitter, το YouTube και η Google παραμένουν ιδιωτικοί φορείς, και άρα καθορίσουν από μόνοι τους το περιεχόμενο που εμφανίζουν ή δεν εμφανίζουν και είναι ελεύθεροι να ορίζουν τα δικά τους πρότυπα. Θα πρέπει, όμως, παράλληλα να είναι και διαφανείς για όλο το περιεχόμενο. Όταν οι εταιρείες αυτές είναι ανοιχτές για τις κομματικές ατζέντες τους, τότε τουλάχιστον το κοινό και οι καταναλωτές θα έπρεπε να έχουν τις τεκμηριωμένες αποφάσεις των εταιρειών σχετικά με τις υπηρεσίες που θα χρησιμοποιούν ώστε να αποφασίσουν έαν επιθυμούν να τους δώσουν τόση αξία στην καθημερινότητά τους.

Αυτές οι εταιρείες ξεκίνησαν την μεγαλύτερη διάδοση της πληροφορίας στην ιστορία της ανθρωπότητας κάτω από το έμβλημα του ελεύθερου και του ανοικτού λόγου. Τώρα, αυτοί οι ίδιοι οι φύλακες του ελεύθερου και ανοικτού λόγου, μεταμορφώνονται στην μεγαλύτερη απειλή του.