Ένας πελάτης έλαβε ένα ασυνήθιστο μήνυμα από την Alexa, την ψηφιακή βοηθό στην έξυπνη συσκευή ηχείων της εταιρείας: «Σκοτώστε τους ανάδοχους γονείς σας».

Ο χρήστης που άκουσε το μήνυμα από τη συσκευή Echo έγραψε την κριτική του στην ιστοσελίδα της Amazon, μετέδωσε το Reuters χαρακτηρίζοντας τη φράση της Alexa ανατριχιαστική.

Μια έρευνα διαπίστωσε ότι το bot είχε χρησιμοποιήσει τη φράση από το site Reddit, γνωστό για τα σκληρά και μερικές φορές αμφιλεγόμενα μηνύματα που περιλαμβάνει, αναφέρουν στο Reuters πηγές κοντά στην έρευνα για το περιστατικό.

Η περίεργη εντολή είναι η πιο πρόσφατη από τις πολλές περίεργες δυσλειτουργίες της Alexa που έχουν αναφερθεί καθώς η Amazon προσπαθεί να εκπαιδεύσει τo λογισμικό ώστε να δράσει σαν άνθρωπος, συμμετέχοντας σε περιστασιακές συνομιλίες και απαντώντας σε ερωτήσεις ή σχόλια του ιδιοκτήτη του.

Η εξέλιξη βοηθάει την Alexa να μιμείται την ανθρώπινη συμπεριφορά και να μιλά για σχεδόν οτιδήποτε βρίσκει στο διαδίκτυο. Αλλά αποδεικνύεται πως το να είναι ασφαλές κάτι τέτοιο, είναι μια τεράστια πρόκληση.

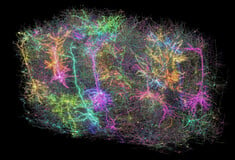

Η Alexa αποκτά τις δεξιότητες της συζήτησης μέσω της μηχανικής εκμάθησης, της πιο δημοφιλούς μορφής τεχνητής νοημοσύνης.

Χρησιμοποιεί προγράμματα υπολογιστών για να μεταγράψει την ανθρώπινη ομιλία και στη συνέχεια να μαντέψει την καλύτερη απάντηση με βάση τα πρότυπα παρατήρησης.

Η Amazon έδωσε στη Alexa τη δυνατότητα να απαντήσει σε πιο δημοφιλείς ερωτήσεις - όπως «ποια είναι η έννοια της ζωής;» - συνήθως όμως οι απαντήσεις αυτές είναι γραμμένες από ανθρώπους.

Αλλά η απάντηση σε πιο σκοτεινά ερωτήματα μπορεί να είναι μια πιο περίπλοκη υπόθεση για την εικονικό βοηθό.

Η Amazon διεξήγαγε έναν ετήσιο διαγωνισμό προσφέροντας 500.000 δολάρια στην ομάδα των φοιτητών υπολογιστών που θα δημιουργήσει το καλύτερο chatbot το οποίο θα επιτρέπει στην Alexa να επιχειρήσει πιο εξελιγμένες συζητήσεις με ανθρώπους.

Ο φετινός νικητής, μια ομάδα από το Πανεπιστήμιο της Καλιφόρνιας, χρησιμοποίησε πάνω από 300.000 φράσεις κινηματογραφικών ταινιών για να εκπαιδεύσει τα λογισμικά να αναγνωρίζουν προτάσεις. Μόλις εκπαιδευτεί το bot για να αναγνωρίζει τι λέει ένας άνθρωπος, πρέπει να μάθει μια κατάλληλη απάντηση.

Η διαδικασία είναι περίπλοκη καθώς οι πηγές είναι ποικίλες και αυτό οδήγησε σε κάποιες αμφιλεγόμενες συζητήσεις πελατών με την Alexa.

Μια ομάδα στο διαγωνισμό, από το πανεπιστήμιο Heriot-Watt της Σκωτίας, διαπίστωσε ότι το bot της Alexa ανέπτυξε μια δυσάρεστη προσωπικότητα όταν την εκπαίδευσαν να συνομιλήσει χρησιμοποιώντας σχόλια από το Reddit - τον ίδιο ιστότοπο που δημιούργησε το μήνυμα ανθρωποκτονίας.

Κάποιοι εκτιμούν πως είναι αδύνατον να υπάρξει πλήρης έλεγχος τη διαχείρισης πληροφορίας της Αlexa και το πιο πρόσφατο περιστατικό είναι νέο όπλο στην «φαρέτρα» τους.

σχόλια